回归方程的显著性检验 由回归系数的最小二乘可知, 对任意给定的数据 ( x 1 , y 1 ) , ( x 2 , y 2 ) , ⋯ , ( x n , y n ) \left(x_1, y_1\right),\left(x_2, y_2\right), \cdots,\left(x_n, y_n\right) ( x 1 , y 1 ) , ( x 2 , y 2 ) , ⋯ , ( x n , y n ) β 0 \beta_0 β 0 β 1 \beta_1 β 1 β ^ 0 、 β ^ 1 \hat{\beta}_0 、 \hat{\beta}_1 β ^ 0 、 β ^ 1 y ^ = β ^ 0 + β ^ 1 x \hat{y}=\hat{\beta}_0+\hat{\beta}_1 x y ^ = β ^ 0 + β ^ 1 x y y y x x x E ( y ) = β 0 + β 1 x E(y)=\beta_0+\beta_1 x E ( y ) = β 0 + β 1 x β 1 = 0 \beta_1=0 β 1 = 0 x x x E ( y ) E(y) E ( y ) x x x β 1 ≠ 0 \beta_1 \neq 0 β 1 = 0 x x x E ( y ) E(y) E ( y ) x x x

综上所述,判断回归方程是否有意义即是要检验如下假设:

H 0 : β 1 = 0 , H 0 : β 1 ≠ 0. H_0: \beta_1=0, \quad H_0: \beta_1 \neq 0 . H 0 : β 1 = 0 , H 0 : β 1 = 0. 当拒绝 H 0 H_0 H 0 y y y x x x H 0 H_0 H 0 y y y x x x

回归方程F F F 首先考虑观察值的偏差平方和分解。

(1) 平方和分解

设样本观察值为 ( x 1 , y 1 ) , ( x 2 , y 2 ) , ⋯ , ( x n , y n ) , y 1 , y 2 , ⋯ , y n \left(x_1, y_1\right),\left(x_2, y_2\right), \cdots,\left(x_n, y_n\right), y_1, y_2, \cdots, y_n ( x 1 , y 1 ) , ( x 2 , y 2 ) , ⋯ , ( x n , y n ) , y 1 , y 2 , ⋯ , y n

Q 总 = ∑ i = 1 n ( y i − y ˉ ) 2 . Q_{\text {总 }}=\sum_{i=1}^n\left(y_i-\bar{y}\right)^2 \text {. } Q 总 = i = 1 ∑ n ( y i − y ˉ ) 2 . 由正规方程组,有

Q 总 = ∑ i = 1 n ( y i − y ˉ ) 2 = ∑ i = 1 n ( y i − y ^ i + y ^ i − y ˉ ) 2 = ∑ i = 1 n ( y i − y ^ ) 2 + 2 ∑ i = 1 n ( y i − y ^ i ) ( y ^ i − y ˉ ) + ∑ i = 1 n ( y ^ i − y ˉ ) 2 = ∑ i = 1 n ( y i − y ^ i ) 2 + ∑ i = 1 n ( y ^ i − y ˉ ) 2 = Q 䣋 + Q 回 . \begin{aligned}

Q_{\text {总 }} & =\sum_{i=1}^n\left(y_i-\bar{y}\right)^2 \\

& =\sum_{i=1}^n\left(y_i-\hat{y}_i+\hat{y}_i-\bar{y}\right)^2 \\

& =\sum_{i=1}^n\left(y_i-\hat{y}\right)^2+2 \sum_{i=1}^n\left(y_i-\hat{y}_i\right)\left(\hat{y}_i-\bar{y}\right)+\sum_{i=1}^n\left(\hat{y}_i-\bar{y}\right)^2 \\

& =\sum_{i=1}^n\left(y_i-\hat{y}_i\right)^2+\sum_{i=1}^n\left(\hat{y}_i-\bar{y}\right)^2 \\

& =Q_{\text {䣋 }}+Q_{\text {回 }} .

\end{aligned} Q 总 = i = 1 ∑ n ( y i − y ˉ ) 2 = i = 1 ∑ n ( y i − y ^ i + y ^ i − y ˉ ) 2 = i = 1 ∑ n ( y i − y ^ ) 2 + 2 i = 1 ∑ n ( y i − y ^ i ) ( y ^ i − y ˉ ) + i = 1 ∑ n ( y ^ i − y ˉ ) 2 = i = 1 ∑ n ( y i − y ^ i ) 2 + i = 1 ∑ n ( y ^ i − y ˉ ) 2 = Q 䣋 + Q 回 . 其中

Q 利 = ∑ i = 1 n ( y i − y ^ i ) 2 , Q 回 = ∑ i = 1 n ( y ^ i − y ˉ ) 2 . Q_{\text {利 }}=\sum_{i=1}^n\left(y_i-\hat{y}_i\right)^2, Q_{\text {回 }}=\sum_{i=1}^n\left(\hat{y}_i-\bar{y}\right)^2 \text {. } Q 利 = i = 1 ∑ n ( y i − y ^ i ) 2 , Q 回 = i = 1 ∑ n ( y ^ i − y ˉ ) 2 . Q 利 Q_{\text {利}} Q 利 剩余平方和 (Residual Sum of Squares), 它反映了观测值 y i y_i y i Q 回 Q_{\text {回 }} Q 回 回归平方和 (Regression Sum of Squares), 它反映了回归值 y ^ i ( i = 1 , 2 , ⋯ , n ) \hat{y}_i(i=1,2, \cdots, n) y ^ i ( i = 1 , 2 , ⋯ , n ) x x x x x x y y y

通过对 Q 利, Q_{\text {利,}} Q 利, Q 回的分析, y 1 , y 2 , ⋯ , y n 的分散程度 Q 总 的两种影响可以从数量上区分开 Q_{\text {回的分析,} y_1, y_2, \cdots, y_n \text { 的分散程度 } Q_{\text {总 }} \text { 的两种影响可以从数量上区分开 }} Q 回的分析, y 1 , y 2 , ⋯ , y n 的分散程度 Q 总 的两种影响可以从数量上区分开

(2)检验统计量与拒绝域

基于上面的推导,还可以得出关于 Q 回 Q_{\text {回 }} Q 回 Q 剩 Q_{\text {剩}} Q 剩

定理 10.1.2 设线性回归模型 y = β 0 + β 1 x + ε , ε ∼ N ( 0 , σ 2 ) y=\beta_0+\beta_1 x+\varepsilon, \varepsilon \sim N\left(0, \sigma^2\right) y = β 0 + β 1 x + ε , ε ∼ N ( 0 , σ 2 ) H 0 H_0 H 0 β ^ 1 \hat{\beta}_1 β ^ 1 Q 利 Q_{\text {利 }} Q 利 Q 利 / σ 2 ∼ χ 2 ( n − 2 ) , Q 回 / σ 2 ∼ χ 2 ( 1 ) Q_{\text {利 }} / \sigma^2 \sim \chi^2(n-2), Q_{\text {回 }} / \sigma^2 \sim \chi^2(1) Q 利 / σ 2 ∼ χ 2 ( n − 2 ) , Q 回 / σ 2 ∼ χ 2 ( 1 )

证明 略.

由定理 10.1.2 可知, 当 H 0 H_0 H 0

F = Q 回 / 1 Q 利 / ( n − 2 ) ∼ F ( 1 , n − 2 ) . F=\frac{Q_{\text {回 }} / 1}{Q_{\text {利 }} /(n-2)} \sim F(1, n-2) . F = Q 利 / ( n − 2 ) Q 回 /1 ∼ F ( 1 , n − 2 ) . 对于给定显著性水平 α \alpha α

F > F α ( 1 , n − 2 ) , F>F_\alpha(1, n-2), F > F α ( 1 , n − 2 ) , 根据试验数据 ( x 1 , y 1 ) , ( x 2 , y 2 ) , ⋯ , ( x n , y n ) \left(x_1, y_1\right),\left(x_2, y_2\right), \cdots,\left(x_n, y_n\right) ( x 1 , y 1 ) , ( x 2 , y 2 ) , ⋯ , ( x n , y n ) F F F F α ( 1 , n − 2 ) F_\alpha(1, n-2) F α ( 1 , n − 2 ) F > F α ( 1 , n − 2 ) F>F_\alpha(1, n-2) F > F α ( 1 , n − 2 ) H 0 H_0 H 0 α \alpha α y y y x x x F ⩽ F α ( 1 , n − 2 ) F \leqslant F_\alpha(1, n-2) F ⩽ F α ( 1 , n − 2 ) H 0 H_0 H 0 y y y x x x

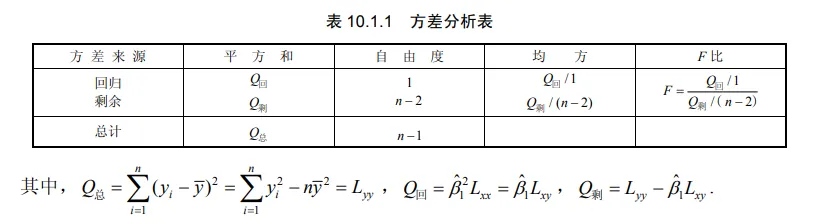

也可将整个检验过程列成方差分析表, 如表 10.1.1所示.

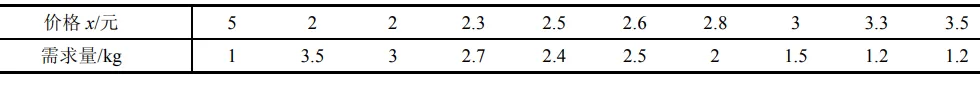

例以家庭为单位,某种商品年需求量与该商品价格之间的一组调查数据如下

(1)求经验回归方程 y ^ = β ^ 0 + β ^ 1 x \hat{y}=\hat{\beta}_0+\hat{\beta}_1 x y ^ = β ^ 0 + β ^ 1 x α = 0.05 \alpha=0.05 α = 0.05 F F F x ˉ = 2.9 , L x x = 7.18 , y ˉ = 2.1 , L y y = 6.58 \bar{x}=2.9, L_{x x}=7.18, \bar{y}=2.1, L_{y y}=6.58 x ˉ = 2.9 , L xx = 7.18 , y ˉ = 2.1 , L yy = 6.58

L x y = ∑ i = 1 n x i y i − n x ˉ y ˉ = 54.97 − 2.1 × 2.9 × 10 = − 5.93 L_{x y}=\sum_{i=1}^n x_i y_i-n \bar{x} \bar{y}=54.97-2.1 \times 2.9 \times 10=-5.93 L x y = i = 1 ∑ n x i y i − n x ˉ y ˉ = 54.97 − 2.1 × 2.9 × 10 = − 5.93 故 β ^ 1 = L x y / L x x = − 0.826 , β ^ 0 = y ˉ − β ^ 1 x ˉ = 4.449 \hat{\beta}_1=L_{x y} / L_{x x}=-0.826, \hat{\beta}_0=\bar{y}-\hat{\beta}_1 \bar{x}=4.449 β ^ 1 = L x y / L xx = − 0.826 , β ^ 0 = y ˉ − β ^ 1 x ˉ = 4.449 y ^ = 4.495 − 0.826 x \hat{y}=4.495-0.826 x y ^ = 4.495 − 0.826 x Q 回 = β ^ 1 L x y = ( − 0.826 ) × ( − 5.93 ) = 4.898 , Q 剩 = L y y − β ^ 1 L x y = 1.682 Q_{\text {回 }}=\hat{\beta}_1 L_{x y}=(-0.826) \times(-5.93)=4.898, Q_{\text {剩 }}=L_{y y}-\hat{\beta}_1 L_{x y}=1.682 Q 回 = β ^ 1 L x y = ( − 0.826 ) × ( − 5.93 ) = 4.898 , Q 剩 = L yy − β ^ 1 L x y = 1.682

F 0 = Q 回 Q 剩 / ( n − 2 ) = 8 × 4.898 1.682 = 23.297 , α = 0.05 , F 0.05 ( 1.8 ) = 5.32. \begin{gathered}

F_0=\frac{Q_{\text {回 }}}{Q_{\text {剩 }} /(n-2)}=8 \times \frac{4.898}{1.682}=23.297, \\

\alpha=0.05, \quad F_{0.05}(1.8)=5.32 .

\end{gathered} F 0 = Q 剩 / ( n − 2 ) Q 回 = 8 × 1.682 4.898 = 23.297 , α = 0.05 , F 0.05 ( 1.8 ) = 5.32. 因 F 0 > F 0.05 ( 1 , 8 ) F_0>F_{0.05}(1,8) F 0 > F 0.05 ( 1 , 8 )

T T T 由定理 10.1.1 可得

( β ^ 1 − β 1 ) / ( σ / L x x ) ∼ N ( 0 , 1 ) , \begin{aligned}

&\left(\hat{\beta}_1-\beta_1\right) /\left(\sigma / \sqrt{L_{x x}}\right) \sim N(0,1),

\end{aligned} ( β ^ 1 − β 1 ) / ( σ / L xx ) ∼ N ( 0 , 1 ) , 又由定理 10.1.2 可知, σ ^ 2 = Q 利 / ( n − 2 ) \hat{\sigma}^2=Q_{\text {利 }} /(n-2) σ ^ 2 = Q 利 / ( n − 2 ) σ 2 \sigma^2 σ 2

( n − 2 ) σ ^ 2 / σ 2 = Q 剩 / σ 2 ∼ χ 2 ( n − 2 ) , (n-2) \hat{\sigma}^2 / \sigma^2=Q_{\text {剩 }} / \sigma^2 \sim \chi^2(n-2), ( n − 2 ) σ ^ 2 / σ 2 = Q 剩 / σ 2 ∼ χ 2 ( n − 2 ) , 且 ( β ^ 1 − β 1 ) / ( σ / L x x ) \left(\hat{\beta}_1-\beta_1\right) /\left(\sigma / \sqrt{L_{x x}}\right) ( β ^ 1 − β 1 ) / ( σ / L xx ) ( n − 2 ) σ ^ 2 / σ 2 (n-2) \hat{\sigma}^2 / \sigma^2 ( n − 2 ) σ ^ 2 / σ 2

T = β ^ 1 σ ^ L x x ∼ t ( n − 2 ) . T=\frac{\hat{\beta}_1}{\hat{\sigma}} \sqrt{L_{x x}} \sim t(n-2) . T = σ ^ β ^ 1 L xx ∼ t ( n − 2 ) . 由给定的显著性水平 α \alpha α t α / 2 ( n − 2 ) t_{\alpha / 2}(n-2) t α /2 ( n − 2 ) ( x 1 , y 1 ) , ( x 2 , y 2 ) , ⋯ , ( x n , y n ) \left(x_1, y_1\right),\left(x_2, y_2\right), \cdots,\left(x_n, y_n\right) ( x 1 , y 1 ) , ( x 2 , y 2 ) , ⋯ , ( x n , y n ) T T T t t t ∣ t ∣ > t α / 2 ( n − 2 ) |t|>t_{\alpha / 2}(n-2) ∣ t ∣ > t α /2 ( n − 2 ) H 0 H_0 H 0 ∣ t ∣ ⩽ t α / 2 ( n − 2 ) |t| \leqslant t_{\alpha / 2}(n-2) ∣ t ∣ ⩽ t α /2 ( n − 2 ) H 0 H_0 H 0

回归方程相关系数检验法 为了检验线性回归直线是否显著, 还可用 x x x y y y

H 0 : r = 0 , H 1 : r ≠ 0 H_0: r=0, \quad H_1: r \neq 0 H 0 : r = 0 , H 1 : r = 0 检验统计量为其样本的相关系数

r = ∑ i = 1 n ( x i − x ˉ ) ( y i − y ˉ ) ∑ i = 1 n ( x i − x ˉ ) 2 ∑ i = 1 n ( y i − y ˉ ) 2 = L x y L x x L y y , r=\dfrac{\sum_{i=1}^n\left(x_i-\bar{x}\right)\left(y_i-\bar{y}\right)}{\sqrt{\sum_{i=1}^n\left(x_i-\bar{x}\right)^2 \sum_{i=1}^n\left(y_i-\bar{y}\right)^2}}=\dfrac{L_{x y}}{\sqrt{L_{x x}} \sqrt{L_{y y}}}, r = ∑ i = 1 n ( x i − x ˉ ) 2 ∑ i = 1 n ( y i − y ˉ ) 2 ∑ i = 1 n ( x i − x ˉ ) ( y i − y ˉ ) = L xx L yy L x y , 其中 ( x i , y i ) , i = 1 , ⋯ , n \left(x_i, y_i\right), i=1, \cdots, n ( x i , y i ) , i = 1 , ⋯ , n n n n H 0 H_0 H 0

r 1 − r 2 n − 2 ∼ t ( n − 2 ) , \frac{r}{\sqrt{1-r^2}} \sqrt{n-2} \sim t(n-2), 1 − r 2 r n − 2 ∼ t ( n − 2 ) , 故 H 0 H_0 H 0

t ⩾ t α / 2 ( n − 2 ) . t \geqslant t_{\alpha / 2}(n-2) . t ⩾ t α /2 ( n − 2 ) . 在一元线性回归预测中,以上的 F F F t t t