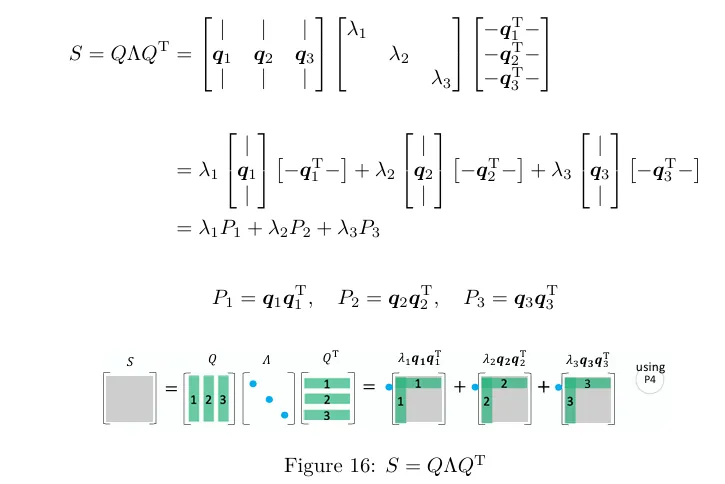

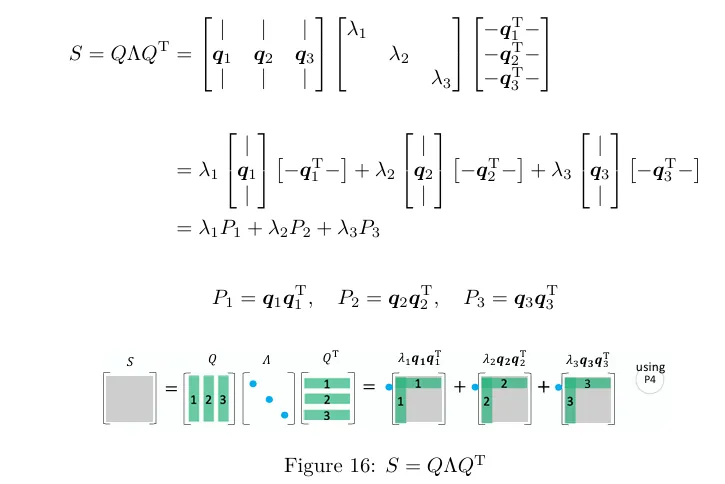

S=QΛQT 特征值分解图解

注意:本文需要特征值与特征向量知识,相加 特征值与特征向量

所有对称矩阵 S 都必须有实特征值和正交特征向量.特征值是 Λ 的对角元素,特征向量在 Q 中.

一个对称矩阵 S 通过一个正交矩阵 Q 和它的转置矩阵,对角化为 Λ 。然后被分解为一阶投影矩阵 P=qqT的组合.这就是谱定理.

S=ST=λ1P1+λ2P2+λ3P3QQT=P1+P2+P3=IP1P2=P2P3=P3P1=OP12=P1=P1T,P22=P2=P2T,P32=P3=P3T 线性代数中一个非常核心且强大的概念——矩阵的特征值分解(Eigen Decomposition),也称为谱分解(Spectral Decomposition)。

1. 核心思想与定义

特征值分解的目标是将一个方阵 A 分解为一组特征向量和特征值,从而揭示其内在的几何性质和结构。

定义:

对于一个 n×n 的方阵 A,如果它存在 n 个线性无关的特征向量,那么它可以被分解为以下形式:

A=PΛP−1 其中:

P 是一个可逆矩阵,其列向量是 A 的 n 个线性无关的特征向量(p1,p2,...,pn)。

Λ (Lambda) 是一个对角矩阵,其主对角线上的元素是 A 的特征值(λ1,λ2,...,λn),这些特征值的排列顺序与 P 中特征向量的排列顺序一一对应。

分解后的形式如下:

A=∣p1∣∣p2∣⋯∣pn∣λ10⋮00λ2⋮0⋯⋯⋱⋯00⋮λn∣p1∣∣p2∣⋯∣pn∣−1

2. 直观理解:矩阵的“自然坐标系”

你可以将特征值分解理解为:在由特征向量构成的“自然坐标系”下,矩阵 A 所代表的线性变换被简化为纯粹的缩放(Stretching/Scaling)操作。

特征向量(P 的列) 定义了变换的“主方向”。在这些方向上,变换的效果最简单。

特征值(Λ 的对角元素) 定义了在这些“主方向”上变换的缩放因子。

∣λ∣>1:拉伸

0<∣λ∣<1:压缩

λ<0:反向

操作过程:

P−1x:将向量 x 从标准坐标系变换到由特征向量构成的“自然坐标系”下。

Λ(P−1x):在新的坐标系下,对向量进行简单的缩放(每个分量乘以对应的特征值)。

P(ΛP−1x):将缩放后的向量再变换回原始的标准坐标系。

整个过程 Ax=PΛP−1x 等价于在原始坐标系下进行复杂的变换,但在“自然坐标系”下看,却只是一系列简单的缩放。

3. 分解的条件与步骤

前提条件:

一个 n×n 矩阵 A 可以进行特征值分解的充要条件是:它拥有 n 个线性无关的特征向量。

满足这个条件的矩阵被称为可对角化矩阵(Diagonalizable Matrix)。

充分非必要条件:如果 A 是实对称矩阵(Symmetric Matrix),那么它必然有 n 个正交的特征向量,并且可以进行特征值分解。

分解步骤:

求特征值(Find Eigenvalues):

解特征方程 det(A−λI)=0,得到 n 个特征值 λ1,λ2,...,λn。

(I 是单位矩阵)

求特征向量(Find Eigenvectors):

对每个特征值 λi,求解齐次线性方程组 (A−λiI)v=0,得到对应的特征向量 pi。

构造矩阵 P 和 Λ:

将求得的 n 个线性无关的特征向量 p1,p2,...,pn 作为列向量,组成矩阵 P=[p1,p2,...,pn]。

将对应的特征值按相同顺序放在对角线上,组成对角矩阵 Λ=diag(λ1,λ2,...,λn)。

验证分解:

检查 A=PΛP−1 是否成立。

4. 例子

设矩阵 A=[2112],求其特征值分解。

Step 1: 求特征值

解特征方程:

det(A−λI)=det[2−λ112−λ]=(2−λ)2−1=0 λ2−4λ+3=0⟹(λ−1)(λ−3)=0 特征值为:λ1=1, λ2=3。

Step 2: 求特征向量

对于 λ1=1:

(A−I)v=[1111][v1v2]=0

解得:v1+v2=0,取 p1=[1−1]。

对于 λ2=3:

(A−3I)v=[−111−1][v1v2]=0

解得:−v1+v2=0,取 p2=[11]。

Step 3: 构造 P 和 Λ

P=[p1p2]=[1−111],Λ=[λ100λ2]=[1003] 计算 P 的逆:

P−1=det(P)1[11−11]T=21[1−111] Step 4: 验证

PΛP−1=[1−111][1003]21[1−111]=21[1−133][1−111]=21[(1−3)(−1−3)(1+3)(−1+3)]=21[−2−442]=[2112]=A 验证成功!

5. 特殊情形:实对称矩阵的谱定理

如果 A 是一个实对称矩阵(A=AT),那么它的特征值分解具有更优美的性质:

所有特征值都是实数。

不同特征值对应的特征向量相互正交。

它可以被分解为:

A=QΛQT 其中 Q 是一个正交矩阵(由单位化的、相互正交的特征向量组成,满足 Q−1=QT),Λ 是对角矩阵。

这种形式避免了求逆运算,计算和应用起来更加方便。主成分分析(PCA) 的核心就是基于实对称矩阵(协方差矩阵)的这个分解。

6. 应用场景

特征值分解是理解和简化复杂线性变换的基石,其应用极其广泛:

解耦系统:在微分方程和动力系统中,可以将耦合的系统解耦为独立的单变量系统。

主成分分析(PCA):用于数据降维,找到数据中方差最大的方向(即特征向量方向)。

振动分析:在机械工程中,用于求解结构的固有频率(特征值)和振型(特征向量)。

量子力学:可观测量的算符对应的矩阵的特征值代表可能的测量结果。

矩阵函数:计算矩阵的幂 Ak=PΛkP−1 或指数 eA=PeΛP−1 变得非常简单。

7. 总结

| 特性 | 描述 |

|---|

| 形式 | A=PΛP−1 (对称阵: A=QΛQT) |

| 矩阵P/Q | 可逆矩阵/正交矩阵,其列向量是 A 的特征向量。 |

| 矩阵Λ | 对角矩阵,其元素是 A 的特征值。 |

| 核心思想 | 在由特征向量定义的“自然坐标系”下,变换简化为纯粹的缩放。 |

| 前提条件 | A 必须是可对角化的,即拥有 n 个线性无关的特征向量。 |

| 主要应用 | 解耦系统、PCA降维、振动分析、计算矩阵函数。 |

简单来说,特征值分解为我们提供了一种“翻译”工具,能将一个复杂的矩阵变换,用最简单的缩放操作来描述。它是连接线性代数理论和应用的桥梁。